Quase todo mundo no financeiro já abriu o ChatGPT pelo menos uma vez para analisar um número, resumir um relatório ou montar uma planilha. O problema é que a maioria das pessoas faz isso sem saber exatamente o que acontece com os dados que insere. E no financeiro, os dados são sempre sensíveis.

A adoção é real: segundo a McKinsey e Company, 65% das empresas já usam IA generativa de forma regular para produtividade e análise de dados. Mas o uso responsável não acompanhou o ritmo. Segundo levantamento da FGV publicado em 2025, nenhuma das sete principais ferramentas de IA utilizadas no Brasil está plenamente adequada à LGPD. E as multas da ANPD podem chegar a 2% do faturamento anual.

Este guia cobre tudo em um lugar só: quais ferramentas existem, o que cada uma faz bem, em quais áreas faz sentido usar e, principalmente, como usar sem colocar a empresa em risco. Pode favoritar, compartilhar com o time e usar como referência sempre que precisar.

O que você vai ler neste artigo?

- Quais são as principais ferramentas de IA gratuitas disponíveis hoje;

- Em quais áreas cada ferramenta funciona melhor;

- O que acontece com os dados que você insere;

- Quais dados você nunca deve compartilhar com uma IA;

- Um checklist prático de segurança para usar no dia a dia;

- Como criar uma política de uso de IA na sua empresa.

O que são ferramentas de IA e por que todo mundo está usando?

LasLos ferramentas de IA são sistemas que entendem linguagem natural, produzem texto, analisam dados, escrevem código e respondem perguntas em tempo real. Você digita uma instrução (chamada de prompt) e a ferramenta responde como um assistente inteligente.

A razão pela qual o uso explodiu é simples: elas funcionam. Um analista que antes levava uma hora para consolidar dados e escrever um resumo executivo consegue fazer isso em dez minutos com uma boa ferramenta de IA. Um time fiscal que precisava ler vinte páginas de uma norma tributária pode pedir um resumo dos pontos principais em segundos.

Mas existe uma diferença importante que muita gente ignora: ferramentas de IA gratuitas e de uso pessoal têm regras de privacidade muito diferentes das versões corporativas e pagas. E no financeiro, onde os dados são confidenciais por natureza, essa diferença importa muito.

Quais são as principais ferramentas de IA gratuitas disponíveis hoje?

Existem várias opções no mercado, cada uma com pontos fortes diferentes. Aqui estão as mais usadas no ambiente corporativo brasileiro:

| Ferramenta | Criada por | Melhor para | Atenção |

|---|---|---|---|

| ChatGPT | OpenAI | Textos, análises, resumos, relatórios. Versátil para qualquer área | Por padrão, conversas podem ser usadas para treinar modelos. Desative nas configurações |

| Gemini | Quem usa Google Workspace. Integra com Gmail, Docs, Sheets e Drive nativamente | Versão gratuita sem garantias contratuais de privacidade | |

| Copilot | Microsoft | Quem usa Microsoft 365. Já integrado ao Word, Excel, PowerPoint e Teams | Versão gratuita difere muito da corporativa em segurança e conformidade |

| Claude | Anthropic | Documentos longos, contratos, normas regulatórias. Mais natural em português | Servidores nos EUA. Transferência internacional de dados se aplica |

| DeepSeek | DeepSeek AI (China) | Uso intenso sem limite de mensagens. Pode ser rodado localmente | Origem chinesa gera preocupações de soberania de dados em ambientes mais regulados |

| Perplexity | Perplexity AI | Pesquisa com fontes verificadas e informações atualizadas em tempo real | Foco em pesquisa, não substitui as ferramentas de geração de texto nas outras tarefas |

Em quais áreas as ferramentas de IA já estão sendo usadas?

Aqui está um mapa prático de uso por área, com as tarefas mais comuns que já funcionam bem hoje:

| Área | Tarefas em que a IA já ajuda | Ferramenta mais indicada |

|---|---|---|

| Finanzas | Resumir relatórios, criar fórmulas, analisar variâncias, rascunhar comentários de resultado | Copilot (Excel/Word) ou ChatGPT |

| Impuesto | Resumir normas tributárias, explicar mudanças regulatórias, montar checklists de obrigações | Claude ou ChatGPT |

| Contabilidad | Análise de balancetes, identificar inconsistências, resumir relatórios para não contadores | ChatGPT ou Copilot |

| Contraloría | Preparar apresentações, criar narrativas de resultado, rascunhar análises de variância | Copilot ou ChatGPT |

| Jurídico | Resumir contratos, identificar cláusulas relevantes, pesquisar legislação (com extrema atenção a dados) | Claude (melhor para documentos longos) |

| RH | Criar comunicados internos, redigir políticas, resumir feedbacks | ChatGPT ou Gemini |

| TI | Escrever e depurar código, criar documentação técnica, explicar erros de sistema | Copilot (GitHub) ou ChatGPT |

Para entender como as ferramentas de IA estão mudando o comportamento e o perfil dos profissionais de finanças de forma mais ampla, confira o artigo sobre as mudanças que a IA está impondo nas finanças.

O que acontece com os dados que você insere numa ferramenta de IA?

Essa é a pergunta que mais gente deveria fazer antes de usar, mas quase ninguém faz. A resposta varia por ferramenta e por plano.

No caso do ChatGPT gratuito, por padrão, as suas conversas podem ser usadas pela OpenAI para treinar modelos futuros. Isso significa que um texto que você inseriu pode ser usado como dado de treinamento e potencialmente aparecer em respostas para outros usuários. É possível desativar essa configuração, mas poucos usuários sabem disso.

Todas as ferramentas processam os dados em servidores no exterior, principalmente nos Estados Unidos. Isso configura transferência internacional de dados e está sujeito às regras da LGPD e da Resolução nº 8/2025 da ANPD, que detalha as salvaguardas necessárias para esse tipo de transferência.

O dado mais preocupante sobre o cenário atual veio do Cloud and Threat Report da Netskope: a empresa média registra 223 incidentes de violação de políticas de dados relacionados à IA generativa por mês, um número que mais que dobrou em relação ao ano anterior. E a responsabilidade legal por esses incidentes recai sobre a empresa, não sobre o funcionário que colou o dado.

Quais dados você nunca deve inserir numa ferramenta de IA gratuita?

A regra é simples: se o dado não poderia ser enviado para um e-mail público sem risco, não deve entrar numa ferramenta de IA gratuita. Na prática, isso inclui:

- Dados pessoais de clientes: CPF, CNPJ, nome completo, endereço, dados bancários de terceiros;

- Planilhas e relatórios financeiros reais: faturamento, margens, posição de caixa, salários, projeções estratégicas;

- Dados de negociações em andamento: termos de contratos, propostas comerciais, condições de M&A;

- Senhas e credenciais de acesso: nunca, em nenhuma hipótese, em nenhuma ferramenta;

- Informações de auditorias e fiscalizações: dados de processos tributários, notificações da Receita, estratégias de defesa;

- Dados de colaboradores: avaliações de desempenho, histórico salarial, informações de saúde.

Um caso que ficou famoso ilustra bem o risco: em 2023, a Samsung proibiu o uso do ChatGPT internamente depois que funcionários inseriram código interno confidencial do setor de semicondutores para pedir ajuda da IA. O dado saiu dos servidores da empresa para os servidores da OpenAI e não havia forma de apagá-lo. No financeiro, o risco equivalente seria inserir um balancete real ou uma projeção de resultado com os números reais da empresa.

Como usar ferramentas de IA com segurança? Checklist de 8 boas práticas!

Estas são as práticas que todo time financeiro deveria adotar antes de incorporar ferramentas de IA no fluxo de trabalho:

1. Anonimize antes de inserir

Quando precisar analisar dados reais com uma ferramenta de IA, substitua os dados sensíveis por dados fictícios antes de inserir. Troque o nome da empresa por “Empresa X”, o CNPJ por números genéricos, os valores reais por proporcionais inventados. O modelo de IA vai fazer a análise normalmente sem você expor nada.

2. Desative o treinamento de dados no ChatGPT

No ChatGPT, vá em Configurações, depois Controles de dados, e desative a opção “Melhorar o modelo para todos”. Isso impede que suas conversas sejam usadas como dado de treinamento. É a primeira coisa a fazer antes de qualquer uso corporativo.

3. Use versões corporativas quando disponível

Se a empresa já tem Microsoft 365, o Copilot for Microsoft 365 inclui garantias contratuais de que os dados não são usados para treinar modelos e estão sujeitos às políticas de compliance do contrato corporativo. O mesmo vale para o Google Workspace com Gemini Enterprise.

4. Não use contas pessoais para trabalho

Usar uma conta pessoal de ChatGPT para tarefas de trabalho cria um ponto cego para a empresa: o departamento de TI não tem visibilidade do que está sendo inserido e a propriedade intelectual sai sem controle. Sempre use contas corporativas quando disponíveis.

5. Nunca copie dados de sistemas internos diretamente

O fluxo mais arriscado é exportar um relatório do ERP e colar direto na IA. Se precisar de ajuda com um relatório real, use estruturas de exemplo com dados fictícios para ensinar o modelo a formatar ou analisar, depois aplique a lógica manualmente nos dados reais.

6. Documente o uso no time

Mantenha um registro de quais ferramentas o time usa e para quais tarefas. Além de ser uma boa prática de governança de dados, facilita a identificação de riscos antes que virem incidentes.

7. Verifique sempre o que a IA produz

Ferramentas de IA podem gerar números incorretos, inventar normas regulatórias que não existem ou confundir datas. No financeiro, onde um dado errado pode comprometer uma decisão, tudo o que a IA produz precisa ser revisado por um humano antes de ser usado.

8. Crie uma política de uso antes de ampliar a adoção

Se o time ainda não tem uma política de uso de IA aprovada pela liderança, o checklist acima é um bom ponto de partida. Uma política simples, de uma página, define o que pode e o que não pode ser inserido, quais ferramentas são permitidas e quem é responsável por monitorar o uso.

Existe diferença de segurança entre a versão gratuita e a corporativa?

Sim, e a diferença é significativa. As versões corporativas das principais ferramentas incluem:

- Garantia contratual de que os dados não são usados para treinamento de modelos;

- Controles de acesso por usuário e por grupo, com log de atividades auditável;

- Conformidade contratual com LGPD, GDPR e outras regulações, documentada em contrato;

- Isolamento de dados entre a empresa e outros clientes da plataforma;

- Suporte e SLA para incidentes de segurança.

O plano gratuito não oferece nenhuma dessas garantias. Para uso pessoal e esporádico com informações públicas, funciona bem. Para uso corporativo com qualquer dado da empresa, a versão paga ou corporativa é sempre mais adequada.

Como os agentes de IA vão além das ferramentas de chat?

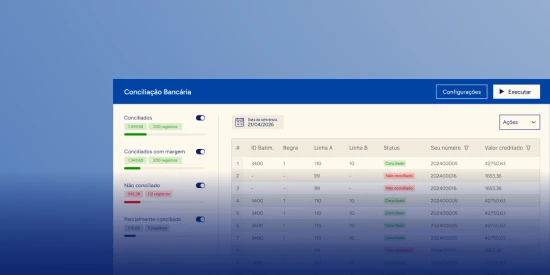

As ferramentas de chat como ChatGPT e Gemini são só o começo. O próximo nível são os agentes de IA, sistemas que não apenas respondem perguntas mas executam tarefas de ponta a ponta: acessam sistemas, cruzam dados, geram relatórios e tomam decisões dentro de regras definidas.

No financeiro, agentes já estão sendo usados para conciliar extratos bancários, classificar lançamentos, monitorar vencimentos e alertar sobre divergências, tudo de forma autônoma. A diferença em relação ao uso de um chatbot é que o agente age, não apenas responde.

Para entender como criar boas instruções para qualquer ferramenta de IA, confira o guia sobre como criar prompts do zero. A qualidade da instrução define a qualidade da resposta.

FAQ: o que mais você precisa saber sobre ferramentas de IA?

As dúvidas mais comuns de times financeiros sobre ferramentas de IA no trabalho:

Posso usar o ChatGPT para analisar contratos da empresa?

Depende. Se o contrato tem dados pessoais de clientes ou informações confidenciais, não deve ser inserido em ferramentas gratuitas. Se for uma estrutura genérica de contrato, sem dados reais, pode ser usado para análise de cláusulas e identificação de pontos de atenção. A boa prática é sempre anonimizar antes de inserir qualquer documento.

A empresa pode proibir o uso de ferramentas de IA?

Pode, mas as evidências mostram que isso raramente funciona. Pesquisas indicam que funcionários continuam usando ferramentas de IA mesmo quando há proibição, simplesmente sem comunicar. A abordagem mais eficaz é criar uma política de uso seguro, orientar o time e disponibilizar alternativas corporativas aprovadas.

O que é shadow AI e por que é um problema?

Shadow AI é o uso de ferramentas de IA sem o conhecimento ou aprovação do departamento de TI ou da liderança. É o equivalente ao shadow IT: o colaborador usa o que acha útil, sem seguir as políticas da empresa. O problema é que a empresa assume a responsabilidade legal pelos dados inseridos, independentemente de saber ou não que o uso estava acontecendo.

Ferramentas de IA cometem erros?

Sim, com frequência. O fenômeno se chama alucinação: a IA pode gerar informações incorretas com a mesma confiança com que gera as corretas. No financeiro, isso é especialmente perigoso em cálculos, citações de normas regulatórias e dados históricos. Toda resposta de IA deve ser tratada como rascunho, não como verdade final.

O DeepSeek é seguro para uso corporativo?

O DeepSeek é uma ferramenta de código aberto desenvolvida por uma empresa chinesa. Para uso pessoal e com dados públicos, funciona bem. Para uso corporativo com dados sensíveis, o fato de ser chinesa e estar sujeita à legislação da China sobre acesso a dados levanta questões legítimas de soberania que muitas empresas preferem evitar. Se o ambiente de TI permitir, é possível rodar o DeepSeek localmente, o que elimina o risco de transferência de dados para servidores externos.

Como saber se uma ferramenta de IA é adequada para uso na minha empresa?

Três perguntas básicas: Onde os dados são processados e armazenados? A ferramenta tem contrato de processamento de dados (DPA) disponível? Ela permite desativar o uso dos dados para treinamento? Se a resposta a essas três perguntas for clara e satisfatória, a ferramenta tem condições mínimas de ser avaliada para uso corporativo.

Quer usar ferramentas de IA com inteligência e segurança no seu time financeiro?

Saber quais ferramentas existem é o passo um. Saber como aproveitá-las de verdade no contexto financeiro, sem risco e com resultado, é o que separa quem experimenta de quem incorpora IA na rotina de forma sustentável.

La formação em inteligência artificial da Dattos foi desenvolvida para profissionais de finanças que querem dominar ferramentas de IA na prática: desde criar prompts eficazes para análise financeira até automatizar tarefas com agentes e ferramentas de integração como o n8n, cobrindo tudo com foco em segurança e conformidade com a LGPD.

Matricule-se gratuitamente e prepare seu time para usar inteligência artificial com confiança.